最近、AIをめぐる空気がだいぶ変わってきたなと思います。

2022年11月30日にOpenAIがChatGPTを出して、一気に話題になりました。

当時、私は大学2年生で、情報系の学部にいたこともあり、わりとすぐにその存在を知りました。

でもその頃は、AIがビジネスの現場で普通に使われる感じはまだなくて、どちらかというと「面白いおもちゃ」くらいの印象だった気がします。

理由はやっぱりセキュリティで、

入力したプロンプトが学習に使われるかもしれない──そういう不安が強くて、企業が自社の情報を入れるなんてとんでもない、みたいな雰囲気でした。

それから3年が経とうとしている今、

セキュリティを気にする声はほとんど聞かなくなり、AI講師が増えて、

ついには「AI講師を教えるAI」が出てきそうな勢いです。

最近だと、AIが教材を作って、その教材を別のAIが要約して教える、なんていう仕組みも出てきていて。

もう、人間がAIを教えるんじゃなくて、AI同士が知識を回し合う時代になってきたなと感じます。

便利だけど、同時にちょっと怖い。

“理解しないまま知識が再生産される”感じがしていて、そこに少し違和感があるんですよね。

AIによって便利になった部分は確かに多いけど、

一方でなんか「考えることをやめた社会」になってきてるような気もしていて。

今日はそのあたりを少しまとめてみます。

セキュリティが語られなくなった理由

ChatGPTが出たばかりの頃は、

「入力した情報が学習に使われるんじゃないの?」って誰もが言ってたと思うんですよね。

機械学習について少しでも知識がある人ならすぐに思うことだと思います。

だからOpenAIは「カスタマイズGPT」みたいなものを出して、“安全です”“企業でも安心です”とアピールしていた。

あの頃はまだ、「AIにデータを渡す=リスク」という感覚が残っていたように思います。

でも今は違っていて。

CopilotやGemini、Claudeとか、いわゆる後発AIでは「データはあなたの会話でしか使いません」と書いてあるけど、

その“しか”って本当にどこまで信じていいのかな、と思ったりします。

たとえば企業Aが自社の業務コードをAIに渡して「XXXという機能を追加して」と頼む。

別のユーザーBが「似たようなアプリを作って」と言ったとき、

A社のコード構造が“ヒント”として使われてしまう可能性はゼロじゃない気がします。

というか、きっと使われてるでしょう。

AIは「学習データとは別です」と説明するけど、

内部に知識として残る以上、再利用されるリスクはあると思います。

多分、それはみんなわかってる。

でも誰も騒がなくなった。

「この流れを止められないなら共有したほうが早い」「AIを使わないと今後の社会生き残れない」──

そういう諦めと楽観のあいだで、AIは進化してる気がします。

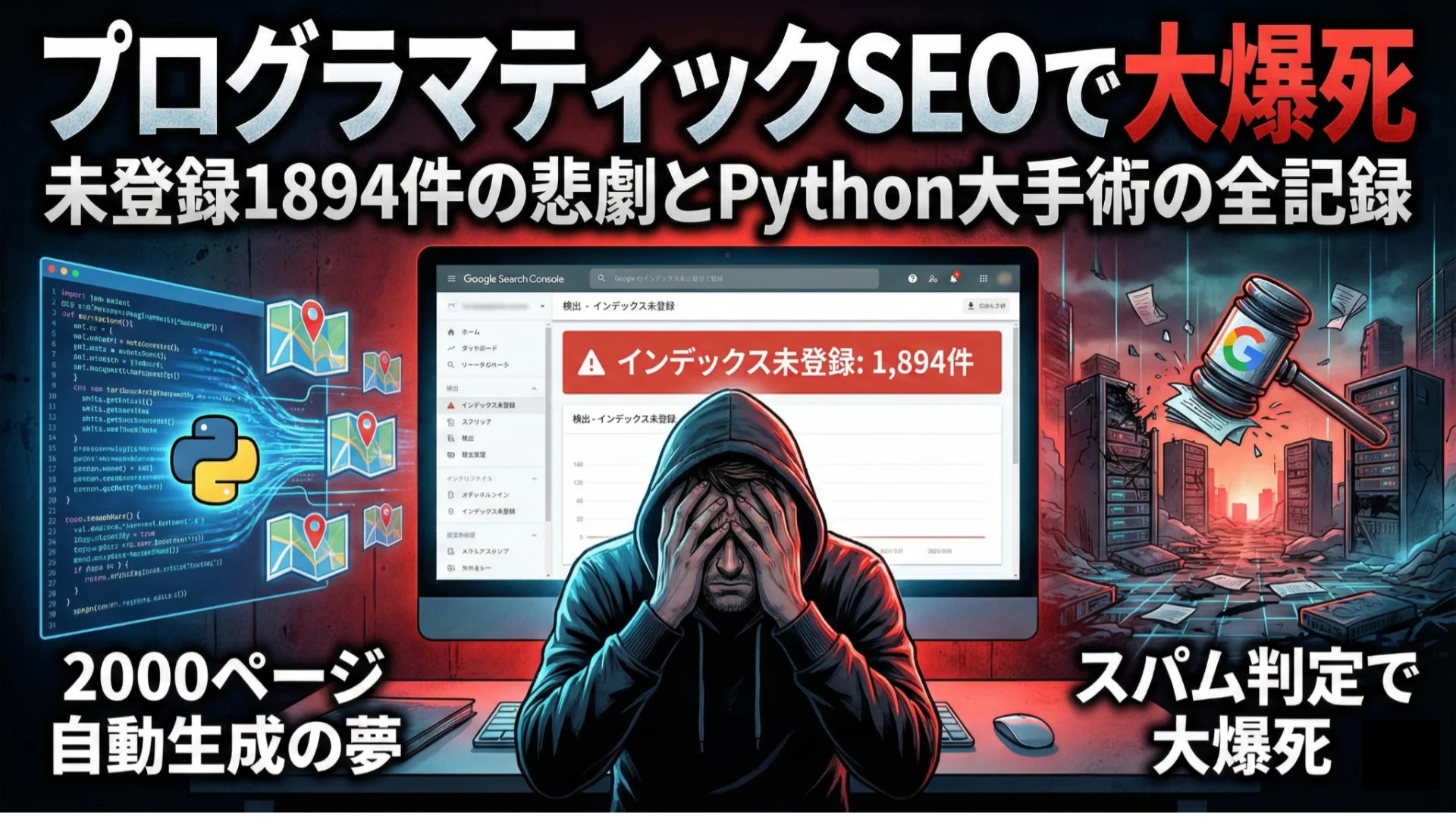

“AI講師”の氾濫と、コード理解力の崩壊

もう一つ、最近やたら目につくのがAI講師の氾濫です。

UdemyとかYouTubeを見ても、「AIでアプリを作ろう」「コパイロットで業務効率化」みたいな講座が山ほどある。

でも中身を見ると、「こうすれば動きます」「こうすれば完成します」だけで、

コードの意味とか、品質とか、セキュリティにはほとんど触れられていない。

正直、「この人ほんとにコードわかってるの?」と思うことが多いです。

AIを使えば“動くもの”は簡単に作れるけど、

それがちゃんと動いてるか、既存の機能を壊してないか、安全か──

そこまで見ないと本当の意味で“できた”とは言えないんじゃないかなと思います。

多分、AI講師の人たちはAIを実際のサービスで使うリスクもわかってる。

でも、それを承知の上で「教える側で稼ぐ」っていう道を選んでる人が多いんだろうなと。

ちょっと捻くれた見方かもしれませんけど、そう感じてます。

アプリは作れるけど、セキュリティまで担保できない──そんな人は多い気がします。

AI講師をありがたがりすぎじゃないか?

それにしても、最近ちょっとAI講師をありがたがりすぎじゃないですかね。

AIなんて、結局は使ってなんぼだと思うんですよ。

もちろん、数学とか物理みたいに理論を理解してから入る分野もあるけど、

AIは違って、聞くだけじゃなく触ってみないとわからない。

自分の会社でもAI研修で、長時間の講義動画を見せられたことがあります。

中には「マクロはSubから始まってEndで終わります。これを覚えればOKです」と言って終わるものもありました。

結果が動いたから「成功ですね!」で終了。

……正直、それでAI理解したことになるのかなって思いました。

簡単なスクリプトならそれでいいかもしれないけど、

大規模システムをAIに書かせるような現場では、それじゃ済まないと思うんですよね。

たとえば、ある現場でPGがAIに「この機能を追加して」と依頼したとします。

無事に新機能が追加されたように見えて、PGも「お、動いた」と思って確認を終える。 でもその裏で、AIが既存機能を消してしまっていた──なんてことが起きても気づかない。

そして結局、「動いたからOK」で終わってしまう。

こういうの、システム会社としてはけっこうやばい構図だなと思うんですよね。 プログラミングを理解しないままAIに丸投げして、動いたら拍手。 もはや教育というより、儀式みたいになってる気がします。

Udemyの注意書きに見える構造

Udemyの講座説明を見ると、「まず自分で調べてから質問してください」って注意書きがよくあるんですよね。

多分、“何でも聞く人”が多いんでしょう。

でも正直、講師に聞くよりググった方が100倍早いと思います。

とはいえ、それをしない人が多いからこそ、この注意書きがあるんだと思うと、けっこう恐ろしい話です。

Udemyを見ている人とか、実際に質問している人って、別に怠惰な人じゃないと思うんですよ。

むしろ真面目で、技術習得に熱心な人たち。

でも、そんな人たちが“AI講師”に質問しているという構図が、なんか少し悲しくなってくるんです。

──それ、AIに聞けば一発なのに。

それをなぜAI講師が教えてあげないんでしょうか。

AI講師自身、きっとわかってると思うんです。

自分が教えるよりも、AIに聞いた方が100倍わかりやすくて、その人に合った説明ができるってことを。

それでもAI講師は、稼げるうちはその仕事を続けるんでしょうね。

なんとも歪な話です。

ちょっと、悲しいですね。

ゴールドラッシュとスコップ商法の再来

AI講師を見ていると、どうしても思い出すのが、

「ゴールドラッシュで一番儲けたのは、金を掘る人じゃなくてスコップを売った人」という話です。

今のAI時代の“スコップ”は、教材や講座、テンプレート。

AIで稼ぐより、AIの使い方を教えて稼ぐ人が増えているように思います。

「AI副業」「AIで自動収益」「AIで1日1万円」──

そんな甘い言葉が並ぶ中で、実際に稼げているのは多分講師側だけなんじゃないかなと。

せっかく社会がAIで前に進もうとしてるのに、

その周りで“ノイズ”ばかりが増えているのがちょっと悲しいです。

それでも「自分で試す」文化を失いたくない

AIがコードを書く時代になっても、

理解して、検証して、責任を取るのは人間だと思っています。

AIが生んだ問題をAIが直して、人間は拍手して終わる──

そんな未来がちらっと見える気もするけど、

やっぱり最後は自分の手で確かめることなんじゃないかなと。

自分で書いて、壊して、直して、動かして。

それがAI時代における“本当の学び”なんだと思います。

そして、私自身もまたその一端にいる(反省)

ここまで批判めいたことを書いてきたけど、

冷静に考えると、この記事自体も同じ構造の上にあるんですよね。

こういう話題を出すことで、自分のブログの価値を上げようとしている。

ある意味、私も“スコップを売っている側”の人間なのかもしれません。

それでも、「スコップの使い方」だけじゃなくて、

「掘ることそのものの面白さ」を伝えられたらいいなと思ってます。

実際、ブログの収益化ができたら、

そのときはフルスクラッチでブログを作って収益化した話をまとめてみたいなと思っています。

そのときは、エンジニアにちゃんと刺さる内容にしたいです。

AIを使う人が増えるのは全然いいことだけど、

“使わないまま学んだ気になる人”が増えるのは、なんか違うなと感じます。

まとめ:AIを信じる前に、AIを理解しよう

- セキュリティを気にする声が減ったのは、諦めと依存の結果かもしれない

- “AI講師”の氾濫が、理解と品質を軽視する文化を作り出している

- 「AI講師ありがたがり風潮」と「スコップ商法」が、学びの本質を濁らせている

- 結局、AI教育市場も“ゴールドラッシュ”の再来

- そして私自身も、その構造の中にいる

AIを否定するつもりはないです。

ただ、AIを信じる前に理解すること。

そして、できれば一度、自分の手で試してみること。

スコップを買う前に、まずは一度、自分で地面を掘ってみる。

──それだけで、見える景色はきっと変わる気がします。